Intel Skylake-SP处理器评测(一) 原创

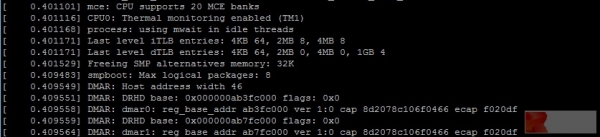

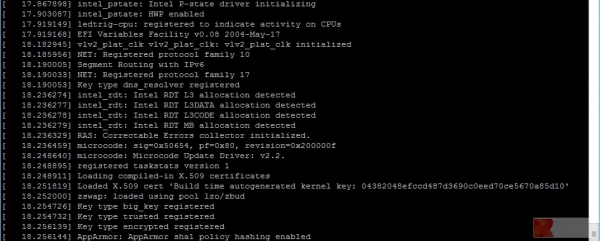

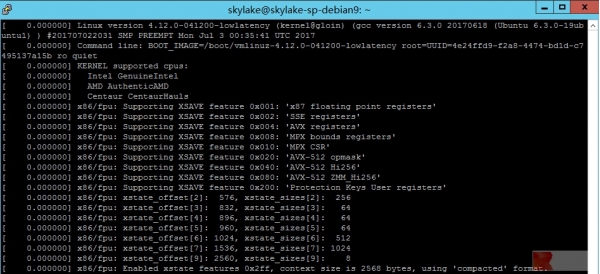

笔者获得了一套四路的Skylake-SP测试样机,内存为768GiB DDR4-2666。为了对最新的Skylake-SP系统测试,笔者需要使用最新版本的系统和软件,笔者安装了Debian GNU/Linux 9.0.0 Stretch x64操作系统,并升级到了最新的Linux Kernel 4.12.0-041200-lowlatency #201707022031 x64,这个Kernel可以完善地支持AVX-512指令集,但相关的测试代码仍然在运行当中。笔者也尝试了RHEL 7.3/CentOS 7.3/SLES 12 SP2,均因为Kernel版本过低无法启动。

Intel 4S Purley/Skylake-SP测试平台说明 by 盘骏/Lucifer,每一个标点符号都经过了反复确认

2017-07-13勘误:实际上,10.4GT/s的UPI的理论带宽应为41.6GB/s。额外地,由于编码方式的改变,效率提升巨大,这部分内容将会在后续文章进行介绍。

Kernel booting with AVX-512/XSAVE

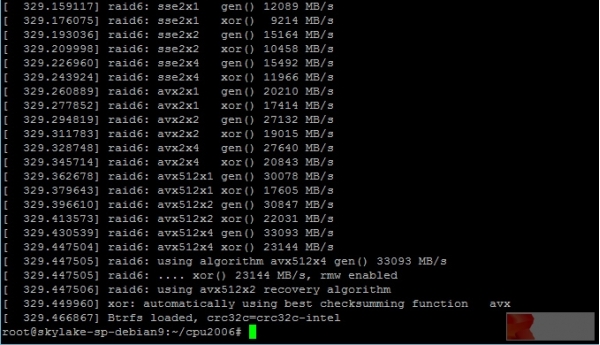

众所周知,Linux Kernel引导的时候会简单测试RAID 5/6的软件性能,上图中,AVX512x4的gen()算法达到了最高的生成性能:33093MB/s,也就是33.093GiB/s

来源:至顶网CBSi企业方案解决中心频道

好文章,需要你的鼓励

亚马逊将从Rivian分拆公司Also采购数千辆助力货运车

Rivian分拆公司Also与亚马逊达成多年合作协议,将为这家电商巨头提供数千辆新型踏板助力四轮货运车TM-Q。该车辆载重超过400磅,体积小巧可使用自行车道。双方将合作定制车辆以满足亚马逊在欧美的配送需求,预计2026年春季投入使用。Also从Rivian内部项目发展而来,今年独立融资1.05亿美元,将利用可拆卸电池技术和专业物流软件为密集城区提供最后一公里配送解决方案。

如何让机器同时“看见“和“听见“?Character AI推出革命性音视频生成模型OVI

Character AI联合耶鲁大学开发的OVI系统实现了音视频的统一生成,通过"孪生塔"架构让音频和视频从生成之初就完美同步。该系统在5秒高清内容生成上显著超越现有方法,为多模态AI和内容创作领域带来突破性进展。

Accel与Prosus联手支持印度早期创业公司

知名投资机构Accel和Prosus宣布建立新的投资合作伙伴关系,专门支持印度初创企业从零开始发展,重点关注那些能够为南亚地区大众提供大规模解决方案的创始人。这是Prosus首次在企业成立阶段进行投资。双方将从创业公司最早期开始共同投资,专注于解决自动化、能源转型、互联网服务和制造业等领域的系统性挑战,初始投资金额从10万到100万美元不等。

南洋理工大学重磅突破:AI图像编辑的“调色板革命“让人人都能成为修图大师

这项由南洋理工大学研究团队开发的DragFlow技术,首次实现了在先进AI模型FLUX上的高质量区域级图像编辑。通过创新的区域监督、硬约束背景保护和适配器增强等技术,将传统点对点编辑升级为更自然的区域编辑模式,在多项基准测试中显著超越现有方法,为图像编辑技术带来革命性突破。

联想戴炜:混合式人工智能加速AI普惠,超级智能体引领智慧城市4.0

小红书入局AI智能体开源DeepAgent,在计划什么更新?

PTC:高科技企业数字化转型的4个案例

亚马逊将从Rivian分拆公司Also采购数千辆助力货运车

Accel与Prosus联手支持印度早期创业公司

CIO们在AI时代最看重新员工的哪些能力

LockBit 5.0扩大攻击范围,勒索软件威胁持续升级

AI时代的身体黑客:病理学新发现

COI Energy解决企业售电难题:让闲置电力变现

高通发布AI加速器并计划部署在神秘机架系统中

华盛顿大学Pedro Domingos:当神经网络遇上逻辑推理,Tensor Logic能否成为AI的通用语言?

IBM推出Digital Asset Haven平台助力银行政府安全管理加密货币