新华三H3C R4700 G3高密机架服务器评测 原创

实际上,我们为测试机器试验了两种操作系统:一种是Debian GNU/Linux 9.3.0 Stretch x64,并搭载了其时最新的Linux Kernel 4.14.6-041406-lowlatency #201712140930 x64内核,但它略微有些不太稳定;第二种是SuSE Linux Enterprise Server 12 SP3 x64(简称SLES12 SP3),基于SUSE当时最新的Linux Kernel 4.4.92-6.30-default x64内核,提供了非常稳定的体验,但内核并没有那么新,最终我们发现它们的性能各有千秋。我们给出的是SLES12 SP3下的数据。

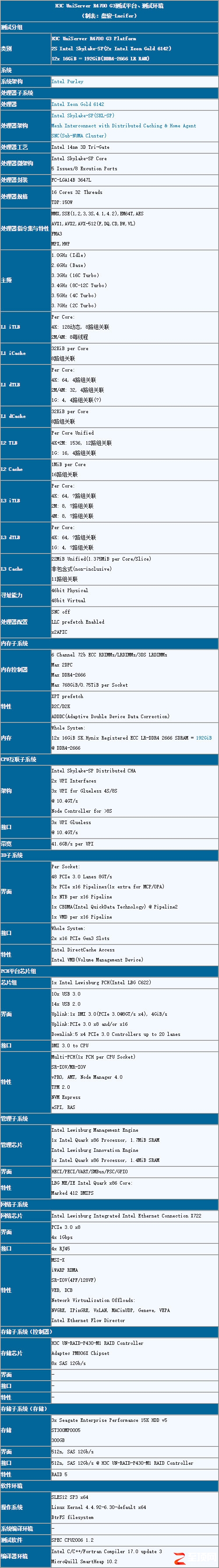

H3C UniServer R4700 G3测试平台与测试环境

测试平台基于双路Intel Xeon SP Gold 6142处理器,主频2.6GHz,最高可以Turbo到3.7GHz(但运行AVX2代码的时候会降低一些),Gold 6142核心数量为16,硬件线程32,整台双路机器就具有32个核心和64个线程。Gold 6142提供了3个10.4GT/s的UPI界面,提供了很高的性能,内存方面,H3C UniServer R4700 G3总共提供24个DDR4 DIMM,合12个内存通道,H3C为我们配置了12条16GiB的SK. Hynix R-ECC DDR4-2666内存以最大化内存性能。H3C UniServer R4700 G3搭载的是Intel Lewisburg C622芯片组,不过它和本文测试的计算性能基本上没有关联,同理,存储子系统也没有产生什么影响。但关于它们还有不少值得称道的地方,我们计划在后面的文章中进行介绍。

好文章,需要你的鼓励

Spotify年度盘点2025首次推出多人互动功能“盘点派对“

Spotify年度总结功能回归,在去年AI播客功能遭遇批评后,今年重新专注于用户数据深度分析。新版本引入近十项新功能,包括首个实时多人互动体验"Wrapped Party",最多可邀请9位好友比较听歌数据。此外还新增热门歌曲播放次数显示、互动歌曲测验、听歌年龄分析和听歌俱乐部等功能,让年度总结更具互动性和个性化体验。

NVIDIA联手多所高校推出SpaceTools:AI机器人有了“火眼金睛“和“妙手回春“

NVIDIA联合多所高校开发的SpaceTools系统通过双重交互强化学习方法,让AI学会协调使用多种视觉工具进行复杂空间推理。该系统在空间理解基准测试中达到最先进性能,并在真实机器人操作中实现86%成功率,代表了AI从单一功能向工具协调专家的重要转变,为未来更智能实用的AI助手奠定基础。

英国SAP用户因商业套件重启授权迷局感到困惑

英国SAP用户表示,Business Suite的授权和定价复杂性正在影响这一云应用新模式的推广。英国和爱尔兰SAP用户组织调查显示,仅27%的用户熟悉今年2月推出的重新设计版Business Suite。61%的受访者认为授权和定价模式是最需要了解的问题。用户在制定从传统系统迁移的商业案例时面临困难,特别是从ECC平台迁移到S/4HANA需要完整的业务转型。ECC主流支持将于2027年结束。

机器人学会“三思而后行“:中科院团队让AI机器人告别行动失误

这项研究解决了现代智能机器人面临的"行动不稳定"问题,开发出名为TACO的决策优化系统。该系统让机器人在执行任务前生成多个候选方案,然后通过伪计数估计器选择最可靠的行动,就像为机器人配备智能顾问。实验显示,真实环境中机器人成功率平均提升16%,且系统可即插即用无需重新训练,为机器人智能化发展提供了新思路。

Spotify年度盘点2025首次推出多人互动功能"盘点派对"

英国SAP用户因商业套件重启授权迷局感到困惑

AWS发布Graviton5定制CPU,为云工作负载带来强劲性能

美光放弃Crucial品牌:告别消费级存储市场

手机里的NPU越来越强,为什么AI体验还在原地踏步?

如何使用现有基础设施让数据做好AI准备

IT领导者快问快答:思科光网络公司首席数字信息官Craig Williams分享AI转型经验

Anthropic CEO警告AI行业泡沫化,批评"YOLO"式投资

雅虎利用AI实时总结橄榄球比赛精彩内容

押注AI智能体,奇奇科技跨越十年的“换挡”与远航

联想天禧AI及创新终端设备在2025 AIE博览会获两项大奖,引领个人AI体验创新

豆包手机助手调整部分AI能力 呼吁保障用户AI使用权